这个问题听起来简单,但答案可能比你想象的更微妙。

很多人讨论 AI 的时候,喜欢问这么一句:

“Human 真的需要 in the loop 吗?”

这个问题听起来很自然,但我越来越觉得,它问得还是有点太粗了。

真正值得问的,不是"要不要人",而是:

人在什么层级、什么条件、以什么成本,留在什么样的 loop 里。

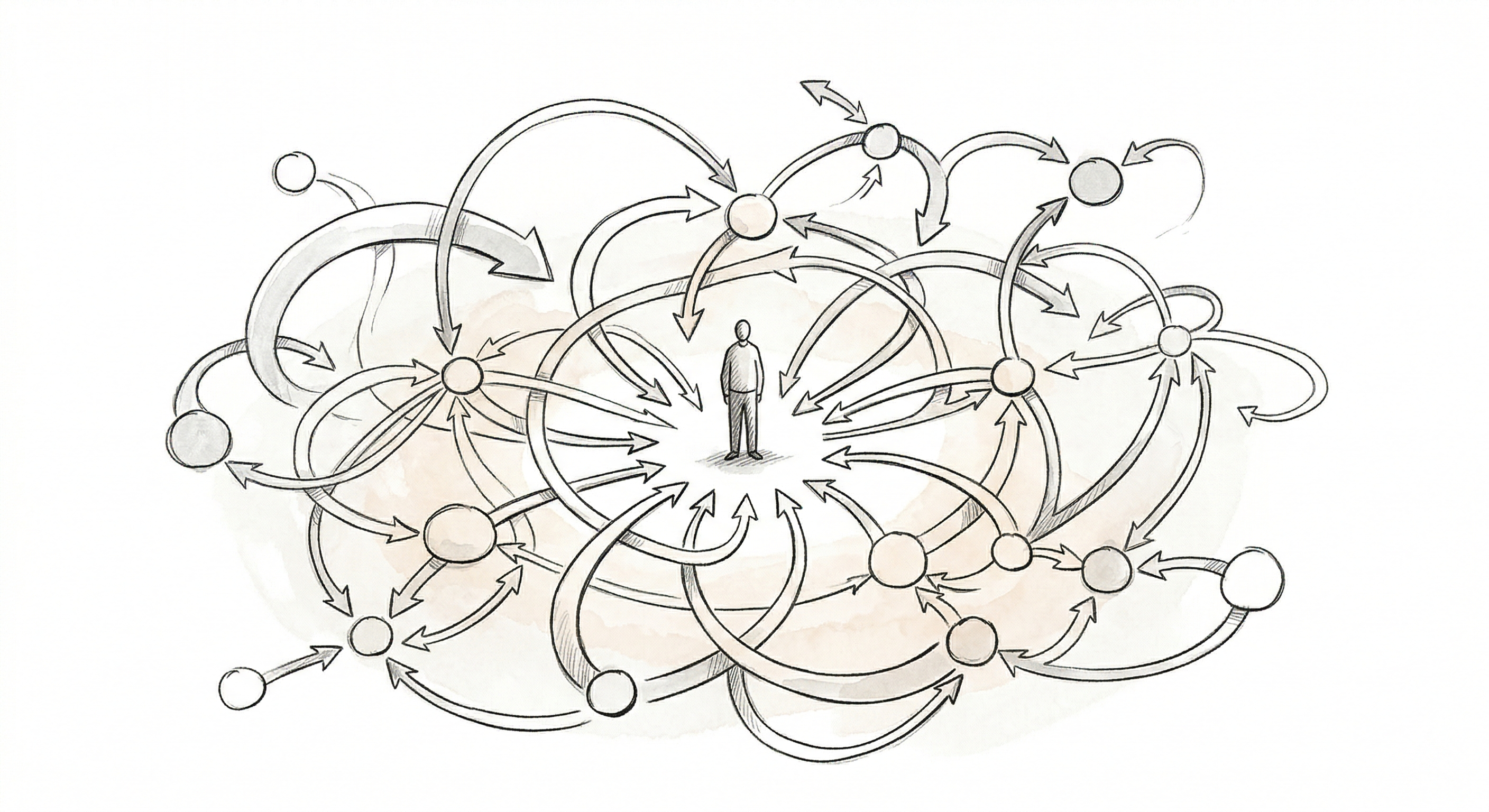

因为 AI 时代真正发生的变化,不是人突然消失了,而是——

人的位置上移了。

很多低层、重复性的执行 loop,确实正在被系统接管。但在更高层的目标定义、结果验收、例外处理、责任承担这些环节,人不但没有退出,反而变得更关键。

所以更准确的问题其实是:未来什么样的人,还能留在高价值的 loop 里。

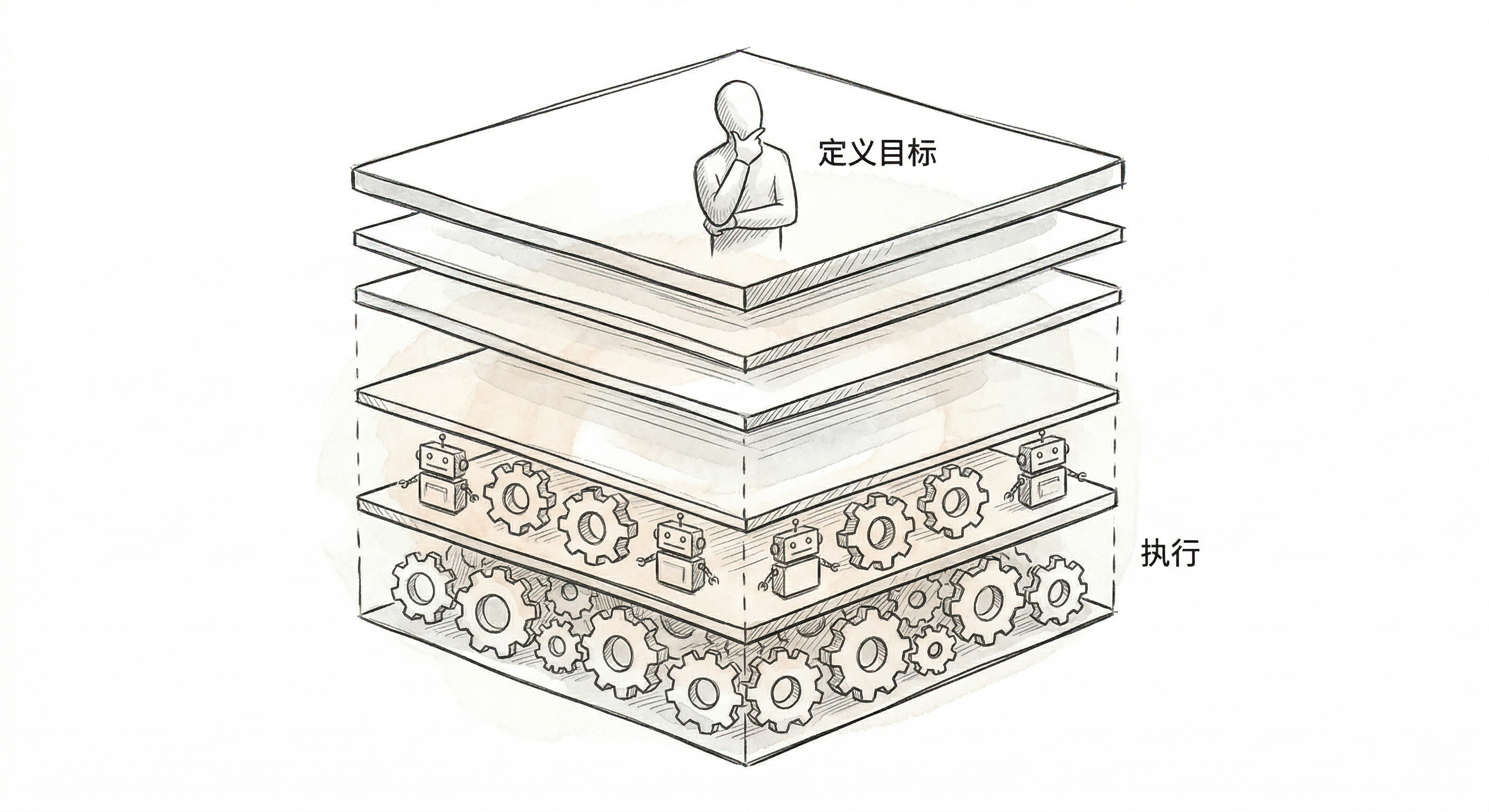

01 / 不是要不要人,而是人留在哪一层

过去很多人理解自动化,总是带着一种二元视角:

- 要么人亲自做

- 要么系统自动做

但真实世界并不是这么切的。

同一个系统里,本来就存在很多层不同的 loop。

低层的 loop,比如调接口、改格式、填表单、搬运数据、执行规则明确的操作——这些最容易被替代。它们目标清楚,输入输出稳定,出错后反馈也容易获得。

高层的 loop,就完全不同了:

- 目标到底是什么?

- 什么叫"足够好"?

- 出现例外时该不该破例?

- 多个目标冲突时先保哪个?

- 一旦出事,谁来承担责任?

这些问题,很难被一句"让 AI 自己做完闭环"带过去。

所以今天真正的变化,不是 human out of the loop,而是:

Human moves up the loop。

人正在从"亲手做每一步",慢慢转向:

- 定义目标

- 设置边界

- 看异常

- 做验收

- 接管例外

- 为结果负责

这才是更准确的现实。

02 / 为什么现阶段人还退不干净

很多人会说,如果需求、方向、标准都定义清楚了,剩下的不就是执行吗?那当然应该尽量 out of the loop。

这话不能说错,但问题在于:现实里的大多数工作,根本没有"定义得那么清楚"。

第一,目标往往没有真的写完整。

组织里很多工作表面上在执行,实际上是在边做边发现问题。

写文章是这样,做产品是这样,运营、管理、招聘、内容治理也是这样。

一开始写下来的"需求",很多只是一个粗略方向。真正重要的标准,常常要到执行过程中才会暴露出来。

比如一段文案到底是不是可用,不只是看语法对不对,而是看:

- 有没有抓住真正的读者情绪

- 有没有说出那个最值得被记住的判断

- 有没有避开空话

- 有没有贴着具体场景说人话

这些东西,一开始根本写不完整。

也就是说,人不只是 spec 的撰写者,很多时候,人还是 spec 的发现者。

第二,生成越来越便宜,但评估并没有同步变简单。

现在很多团队已经发现,生成一份东西没那么难了。写方案、出页面、补代码、整理摘要,模型都能干。

真正难的是:谁来判断这份东西是真的可用,还是只是"看起来像那么回事"。

系统可以做出一个答案,但未必知道:

- 这个答案是不是偏了

- 这个结果经不经得起现实场景

- 这次成功是不是偶然

- 哪些边缘条件还没覆盖到

写作、管理、客户沟通……这些事都不是只看一个指标就能判断好坏的。很多结果是"像对,但不真对"。

所以今天很多时候,human in the loop 不是因为人更高贵,而是因为系统还没有足够成熟的 evaluator。

第三,现实世界里的错误代价并不对称。

在很多业务里,自动化不是"平均正确率高就可以"。

10 次顺利执行,未必抵得过 1 次关键错误造成的损失。

尤其当系统会改真实数据、接触真实用户、触发风控合规动作、影响组织决策……这时候,人留在 loop 里的意义,已经不只是"顺手看看",而是承担几个很具体的功能:

- 作为保险丝

- 作为审计节点

- 作为例外处理者

- 作为错误扩散前的最后一道阀门

有些人把这理解成保守,其实不是。很多时候,这只是对现实世界负责。

03 / 自动化越强,人越像监督者,但这不一定更轻松

很多人喜欢用自动驾驶来类比 AI。这个类比有启发,但只能用一半。

启发在于,复杂系统确实可以分层控制。只要规则足够稳定、执行链路足够成熟,人就可以退出很多微观动作。

但组织里的问题,比开车复杂得多。

开车时,目标大体是稳定的。去哪里、遵什么规则、什么算危险,通常比较清楚。

而组织里的很多工作不是这样。同一个动作,可能同时牵涉效率、风险、公平、体验、品牌、长期关系……这些目标经常彼此冲突,而且不会在开始时就写成一个稳定的目标函数。

更麻烦的是,组织执行不是纯粹的"照着做",而是会在执行中反过来改写问题本身。

一线会发现原目标不现实。用户反馈会让问题被重新定义。执行过程会暴露制度漏洞。

所以在社会系统里,执行不是简单的低层控制,它本身就带着解释与再定义。

而且自动化越强,还会带来另一个问题:

人从操作者变成监督者之后,未必更舒服,甚至可能更脆弱。

长时间不介入,人的判断能力会退化。平时只看报表、不碰现场,一旦真的需要接管,反而未必接得住。

于是组织会进入一种很尴尬的状态:

- 平时系统自己跑

- 出事时又必须人来负责

- 但那个负责的人,可能已经离具体过程太远了

这类问题在航空、金融交易、平台审核、内容治理里都出现过。人没有消失,只是被重新安排到了一个更无聊、也更危险的位置上。

04 / 真正会被淘汰的,不是不干活的人

如果把这件事再往前推一步,问题就变了——

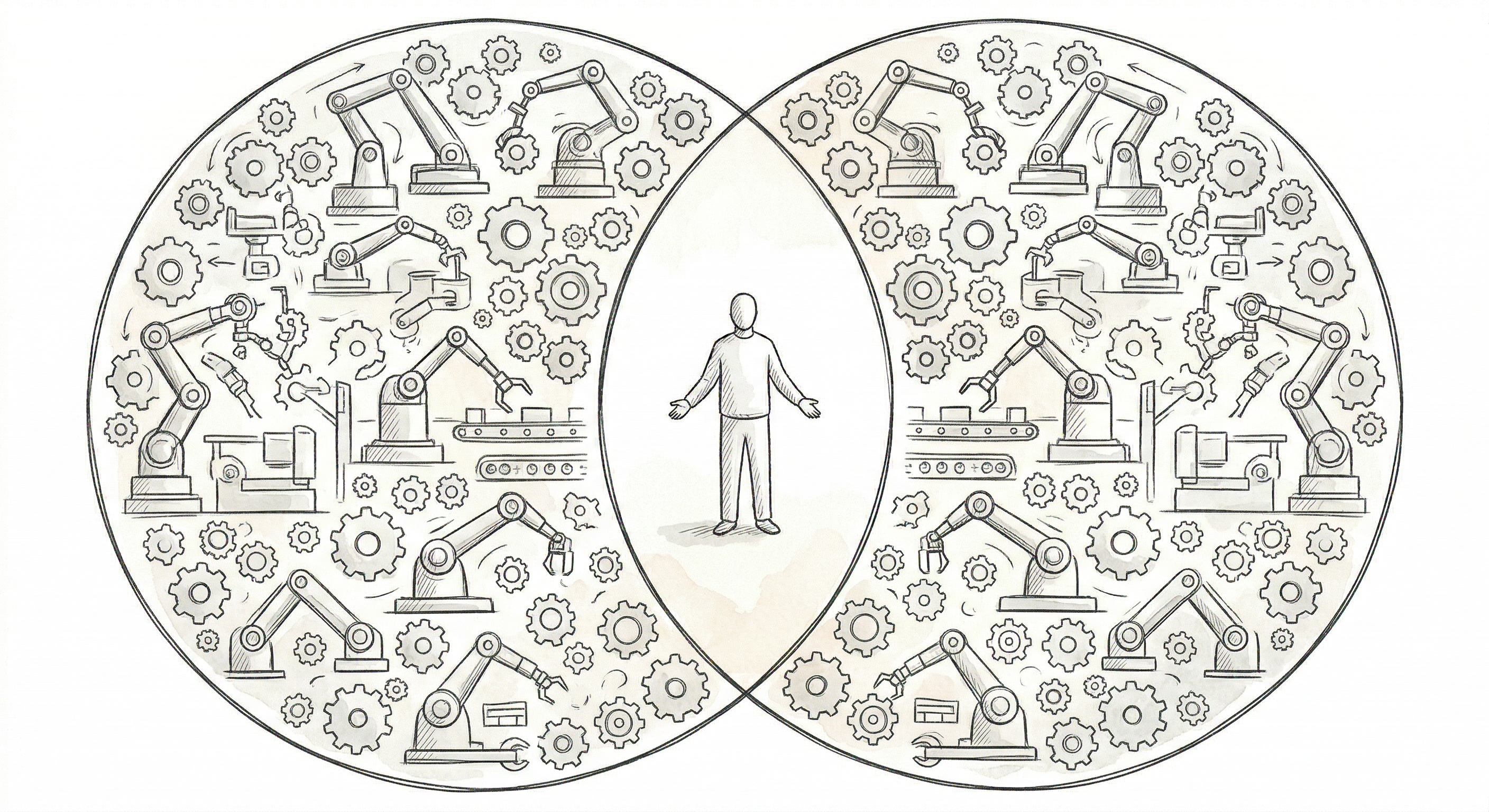

不只是"人还要不要在 loop 里",而是"人还能不能进入那些更值钱的 loop"。

AI 时代最明显的一种迁移路径,大概是这样:

- 人工执行者

- AI 辅助执行者

- 监督 AI 的人

- 处理例外的人

- 设计流程和评估器的人

- 定义目标、资源和约束的人

未来被压缩得最厉害的,往往不是所有岗位,而是那些只占据低层执行 loop、却不掌握定义权、评估权和例外处置权的位置。

换句话说,不是"不在任何 loop 里的人会出局",而是:

不在高价值 loop 里的人,会越来越危险。

真正稀缺的能力,其实是:

- 谁还能定义规则

- 谁还能解释例外

- 谁有权判断结果是否达标

- 谁对系统性后果负责

05 / 对个人来说,真正该焦虑的不是会不会用 AI

今天很多人谈职业焦虑,喜欢把问题说成"会不会用 AI 工具"。

当然,会不会用很重要。但如果只停在这个层面,还是太浅了。

真正更值得焦虑,也更值得提前准备的,是下面这几件事:

- 你能不能把模糊目标说清楚

- 你能不能判断一个结果到底好不好

- 你能不能发现系统在哪里会失控

- 你能不能处理边缘案例和例外情况

- 你能不能在多个冲突目标之间做取舍

- 你能不能为结果承担责任

这些事情很少像"写个 prompt"那样容易被展示出来,但它们会越来越值钱。

因为越往上层走,竞争的核心就越不是"谁做得快",而是"谁能让系统在复杂现实里不失控"。

06 / 但不是每个人,都能在原有组织里进入 right loop

说到这里,还有一个更现实的问题。

前面那些高价值 loop——定义目标、判断结果、处理例外、设计规则、承担责任——听起来都很重要。

但并不是每个人,都有机会在既有组织里自然走到这些位置。

很多组织本身就有很强的层级结构。决策权、资源权、解释权,本来就集中在少数位置上。哪怕一个人已经具备判断力,也未必能立刻进入那些真正关键的 loop。

所以"in the right loop"这句话,如果只理解成在原组织里往上走,还是不够。

还有另一种更现实的路径:

不是等组织把你放进关键 loop,而是主动去外部寻找新的 loop,甚至自己构建一个 loop。

这也是为什么未来越来越多人,可能不只盯着原有岗位晋升,而会开始考虑这些方向:

- 做 OPC(个人公司)

- 进入更小但更灵活的创业团队

- 用个人能力承接明确结果导向的项目

- 成为某个流程、某类判断、某个环节上不可替代的外部资源

关键不在于形式上是"自由职业"还是"在职",而是:你有没有变成别人系统里真正被依赖的一环。

在很多成熟组织里,低层执行岗位最容易被标准化,也最容易被 AI 吸收。但一旦你走到组织外部——小团队、创业团队、OPC——事情会立刻发生变化。

你不会只被要求"完成一个动作",而会被要求:

- 直接解决一个问题

- 直接对一个结果负责

- 在信息不完整时做取舍

- 在资源有限时决定先做什么

- 在系统失控前把事情拉回来

小组织和外部协作环境,反而更容易把一个人推向高层 loop。因为那里没有那么多中间缓冲层,也没有那么强的职责切割。你不能只做局部动作,而必须对一段完整回路负责。

真正重要的,不只是拥有能力,而是成为被依赖的资源。

在 AI 时代,单纯拥有能力,不一定会自动转化成位置。真正稀缺的是:

你的能力有没有被嵌入到某个真实回路里,并且成为别人离不开的资源。

这意味着,个人未来不能只想着"我会不会做",还要想:

- 我解决的是谁的什么问题?

- 我卡住的是哪一个关键节点?

- 如果没有我,这个 loop 会在哪一步失真、失控或停摆?

- 别人为什么愿意持续依赖我,而不是随手换一个工具或外包资源?

07 / 最后回到那个问题

Human 真的需要 in the loop 吗?

答案不是简单的"需要"或者"不需要"。

更准确的说法是:

Human 不需要 in every loop,但必须 in the right loop。

低价值、低风险、规则明确的小 loop,人当然应该尽量退出。让人继续卡在这些地方,不是谨慎,而是浪费。

但在高风险、高歧义、高杠杆的位置上,人依然需要留在回路中。不是因为人天然更聪明,也不是因为人更高贵,而是因为现实世界依然充满:

- 目标不完整

- 评估不稳定

- 错误成本不对称

- 例外永远比流程想象的更多

问题从来不是"AI 会不会把人赶出 loop"。

真正的问题是:当 AI 接管越来越多执行动作时,人还能不能占据那些不可轻易外包的 loop。

未来真正稀缺的,可能不再是执行本身。

而是定义问题、设计边界、判断结果、处理例外、承担责任的能力。

这也许才是 AI 时代关于 human in the loop 更现实的一层答案。